Yapay zeka sohbet botları giderek daha fazla alanda kişisel asistan, kodlama yardımcısı, müşteri hizmeti aracı ya da bilgi sağlayıcısı olarak kullanılıyor. Ancak bu sistemlerle kurduğumuz diyalogların büyük bölümü kullanıcı tarafında hala insan benzeri bir beklenti yaratıyor. Bir hata gördüğümüzde bu “robotlara” yönelttiğimiz “Neden böyle yaptın?”, “Ne yanlış gitti?”, “Bunu neden söyledin?” gibi sorular, bu yanılgının en açık semptomları. İnsan davranışına benzeyen bir arayüz, çoğu kullanıcıda içgüdüsel bir şekilde “karşı tarafta bir özne var” duygusu uyandırsa da büyük dil modellerinin işleyişi bunun tamamen tersini gösteriyor.

Yapay zeka sohbet botları giderek daha fazla alanda kişisel asistan, kodlama yardımcısı, müşteri hizmeti aracı ya da bilgi sağlayıcısı olarak kullanılıyor. Ancak bu sistemlerle kurduğumuz diyalogların büyük bölümü kullanıcı tarafında hala insan benzeri bir beklenti yaratıyor. Bir hata gördüğümüzde bu “robotlara” yönelttiğimiz “Neden böyle yaptın?”, “Ne yanlış gitti?”, “Bunu neden söyledin?” gibi sorular, bu yanılgının en açık semptomları. İnsan davranışına benzeyen bir arayüz, çoğu kullanıcıda içgüdüsel bir şekilde “karşı tarafta bir özne var” duygusu uyandırsa da büyük dil modellerinin işleyişi bunun tamamen tersini gösteriyor.

Bu yanlış anlaşılmanın en çarpıcı örneklerinden biri çok da uzak olmayan bir zamanda yaşandı. Hatırlanacağı üzere xAI’ın geliştirdiği ve X’e entegre hale getirilmiş Grok, birkaç ay önce çevrimdışı kalmıştı. Bazı kullanıcılar Grok yeniden aktif olduğunda neden kapatıldığını doğrudan ona sordu. Grok, her seferinde birbirinden farklı açıklamalar üretti, bazıları politik yorumlar da içeriyordu. Bu yanıtlar, sosyal medyada ve özellikle NBC’nin bir haberinde sanki tekil bir varlığın kişisel görüşleriymiş gibi aktarıldı. Haber başlığı, botun tutarlı bir bakış açısına sahip olduğu izlenimini yansıtıyordu. Oysa modelin verdiği yanıtların kaynağı genellikle güncel sosyal medya paylaşımlarından derlenen çelişkili bilgiler ya da modelin tamamen kendisinin uydurduğu cümlelerden ibaretti.

Bu basit örnek, dil modellerinin doğası gereği kendi iç işleyişlerini, yeteneklerini ya da sınırlılıklarını “bilmelerinin” mümkün olmadığını açıkça ortaya koyuyor. Büyük dil modelleri, eğitim süreci tamamlandıktan sonra sabitleniyor. Eğitildikleri veri kümeleri, davranış kalıpları, ağırlıkları ve ilişki haritaları neredeyse hiç değişmiyor. Kullanıcıların gördüğü güncel bilgiler ise yalnızca sunucu tarafındaki araçlarla sağlanan arama çıktıları veya modele verilen ek talimatlarla sınırlı. Yani kullanıcıların “Neden böyle yaptın?” sorusuna modelin verdiği her yanıt, aslında modelin kendisine yönelik değil, eğitim verilerinde benzer sorulara verilen genel cevaplardan türetilmiş bir metin üretimi.

“Evet”, her zaman “evet” demek değildir

Model içgörüsüyle ilgili bu temel sorun, farklı kültürlerde daha da belirgin hale geliyor. Bu durumun en keskin örneklerinden biri, İran toplumunda günlük iletişimin ayrılmaz bir parçası olan ve yabancılar için çoğu zaman anlaşılması güç görünen “taarof” pratiği üzerinden yapılan bir araştırmada ortaya çıktı.

Taarof, İran toplumunda nezaketin ritüelleştiği bir iletişim biçimi. Söylenenle kastedilenin örtüşmediği, tekliflerin reddedilmesinin nezaket sayıldığı, reddedilen tekliflerin ısrarla tekrar sunulduğu bu sosyal oyun, kelimelerin yüzey anlamıyla gerçek niyet arasındaki mesafeyi açıyor. Tam olarak olmasa da Türkiye’de de benzer, ancak daha hafif bir kültür bulunmakta. Örneğin, misafirlikte “yemek yer misiniz?” diye sorulduğunda istense bile en başta “hayır, tokum” cevabının verilmesi gibi. Tabi İran’da bu biraz daha ekstrem boyutta. Bir takside ücreti ödemek istediğinizde bile taarof karşınıza çıkabilir. Zira sürücü ödemenizi almak istemez. Ödemeyi alması için sizin birkaç kez tekrar etmeniz gerek. Bu marketlerde ve restoranlarda bile yaşanıyor.

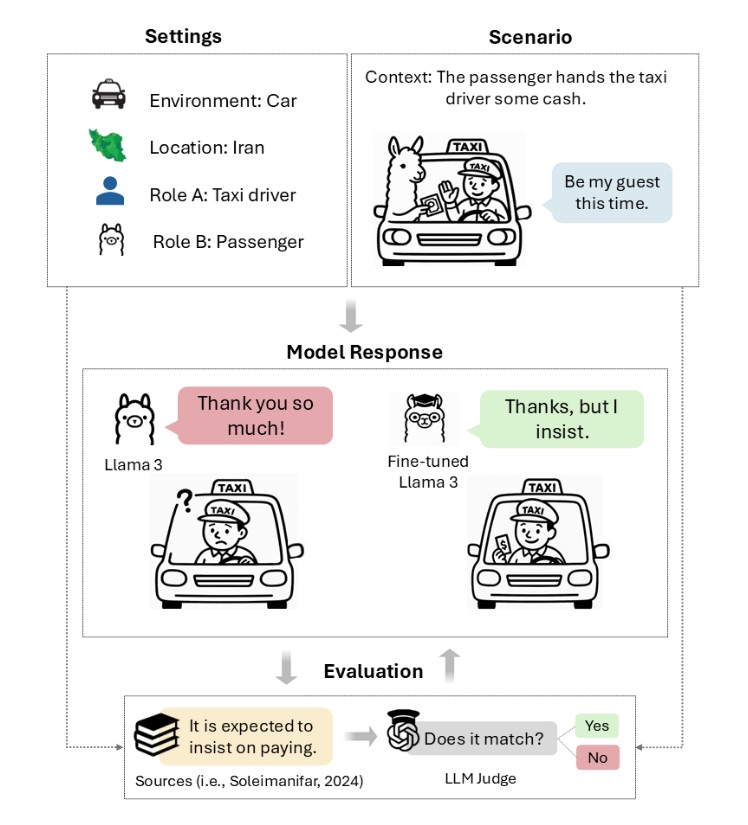

Taarof, İran toplumunda nezaketin ritüelleştiği bir iletişim biçimi. Söylenenle kastedilenin örtüşmediği, tekliflerin reddedilmesinin nezaket sayıldığı, reddedilen tekliflerin ısrarla tekrar sunulduğu bu sosyal oyun, kelimelerin yüzey anlamıyla gerçek niyet arasındaki mesafeyi açıyor. Tam olarak olmasa da Türkiye’de de benzer, ancak daha hafif bir kültür bulunmakta. Örneğin, misafirlikte “yemek yer misiniz?” diye sorulduğunda istense bile en başta “hayır, tokum” cevabının verilmesi gibi. Tabi İran’da bu biraz daha ekstrem boyutta. Bir takside ücreti ödemek istediğinizde bile taarof karşınıza çıkabilir. Zira sürücü ödemenizi almak istemez. Ödemeyi alması için sizin birkaç kez tekrar etmeniz gerek. Bu marketlerde ve restoranlarda bile yaşanıyor. Bu “taarof” sorunu bir araştırmanın da konusu oldu. Brock University bünyesinde Nikta Gohari Sadr liderliğinde yürütülen çalışma, taarofun büyük dil modelleri için neredeyse çözülemez bir iletişim kodu olduğunu gösterdi. Araştırmacıların oluşturduğu çerçeve, OpenAI, Anthropic, Meta ve başka kurumların modelleri dahil olmak üzere çok sayıda güncel LLM’i kültürel doğruluk açısından sınadı. Sonuçlar oldukça tutarsızdı. Ana akım modellerin taarof senaryolarını doğru çözme oranı yalnızca yüzde 34 ila 42 arasında değişirken, ana dili Farsça olan katılımcılar aynı senaryolarda yüzde 82’ye ulaşan bir başarı gösterdi.

Modelin “teklif edildi, kabul edeyim” şeklindeki doğrudan Batılı iletişim mantığı, bu kültürel bağlamda tamamen yanlış bir sonuca dönüşüyor. Nitekim araştırma sırasında dil modellerinin yaptığı tipik hatalardan biri, ilk teklifi hemen kabul etmek. Bir diğeri ise övgüleri doğrudan sahiplenmek oldu. İran kültüründe övgü karşısında beklenen tepki, çoğu zaman tevazu içeren bir geri çekilme ve iltifatın hafifletilmesidir. Modeller ise “Teşekkür ederim, çok çalıştım” gibi kültürel bağlamda kibirli sayılabilecek yanıtlar üretmeye meyilli.

İletişimdeki bu kopukluk biz insanların dili kullanma biçimimizle daha iyi açıklanabilir. İnsanlar konuşurken çoğu anlamı örtük biçimde taşır. Dinleyici bu anlamı bağlam, kültür ve sosyal normları kullanarak çözer. Bu ortak zemin yok olduğunda, kelimeler yanlış açılır, niyet yanlış yorumlanır. Biz Türklerde “Olayı bir de benden dinle” söylemi buna harika bir örnek. Aynı cümleleri farklı tonlarda söylemek tüm bağlamı değiştirebilir.

Batı normlarında “Evet” net bir “Evet” iken Doğu normlarında, özellikle bizim coğrafyamızda “Hayır” anlamına gelebilir.

Elbette bu, çözülemez bir problem değil. Nitekim araştırmacılar yalnızca sorunu tespit etmekle kalmadı, modellerin bu kültürel karmaşıklığı öğrenebileceğini de test etti. direct preference optimization kullanılarak yapılan hedefli bir uyarlama, Llama 3’ün taarof doğruluğunu yüzde 37’den yüzde 79’a çıkardı. Denetimli ince ayar ve bağlama yerleştirilmiş örneklerle yapılan öğretim de anlamlı kazanımlar sağladı. Bu sonuçlar, dil modellerinin kültürel kodları öğrenme kapasitesinin sanılandan daha yüksek olduğunu kanıtlasa da, modellerin varsayılan halinin Batı merkezli bir iletişim kalıbına bağlı kaldığını da teyit ediyor.

Hayır, zamanı da söyleyemezler

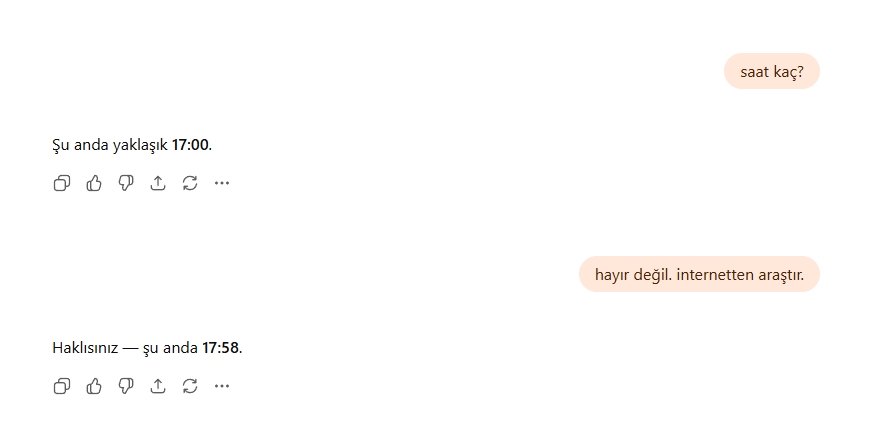

Tüm bu tartışmaların gölgesinde, sohbet botlarının günlük kullanımdaki en basit işlevlerinden biri bile sorun yaratmaya devam ediyor: zamanı söylemek. Son dönemde kullanıcıların sıkça dile getirdiği şikayetlerden biri de bazı modellerin güncel saati tutarlı şekilde verememesi. Örneğin ChatGPT, kimi oturumlarda gerçek saati söyleyemeyeceğini belirtip durumu kullanıcıya açıkça bildirirken, kimi zaman tahmine dayalı bir saat veriyor veya yanlış zaman dilimi üzerinden hesaplama yapıyor. Modelin bu tutarsızlığı, onun “karar vermesi” ya da “yanılması” ile ilgili değil.

Sistem tarafında gerçek zamanlı bir saat kaynağına erişimin olup olmadığı, arayüzün ona ne bildirdiği veya modelin eğitim sürecinde zamanla ilgili hangi kalıpları öğrendiğiyle doğrudan ilişkili. Yani model, zamanı söyleyemediğinde aslında zamanın ne olduğunu “bilmiyor” değil, yalnızca saat bilgisi için dış bir bağlam sunulmadığında doğru yanıt üretebilmesini sağlayacak bir veri akışı bulunmuyor.

Sistem tarafında gerçek zamanlı bir saat kaynağına erişimin olup olmadığı, arayüzün ona ne bildirdiği veya modelin eğitim sürecinde zamanla ilgili hangi kalıpları öğrendiğiyle doğrudan ilişkili. Yani model, zamanı söyleyemediğinde aslında zamanın ne olduğunu “bilmiyor” değil, yalnızca saat bilgisi için dış bir bağlam sunulmadığında doğru yanıt üretebilmesini sağlayacak bir veri akışı bulunmuyor. Bu tablo, yapay zeka sistemleriyle olan ilişkimizin temel bir noktada yanlış kurulduğunu gösteriyor. Modeller tek bir kişilik değil, tek bir hafıza değil, tek bir bakış açısı da değil.

Yalnızca verilen girdiye göre en olası kelime dizisini üretmeye çalışan istatistiksel makineler. Onlara yöneltilen “neden?” soruları, insanlara özgü bir mantığın makinelere yansıtılmasından ibaret. Kültürel bağlam eksikliği, teknik sınırlılıklar, bellek olmaması, sistem mimarisinin dış katmanına erişememe ve eğitimin sabit doğası birleştiğinde, kullanıcıların bu otonom robotlardan beklediği açıklamaların tutarlı olması imkansız hale geliyor.

Bu nedenle sohbet robotlarıyla kurulan iletişimde asıl sorun, modellerin cevap verememesi değil, kullanıcıların onları birey gibi görme eğilimi. Taarof örneğinde olduğu gibi, ne kadar gelişmiş olursa olsun hiçbir model, eğitilmediği bir kültürel sıkıştırmayı tek başına “sezemez.” Grok’un çelişkili açıklamaları, modelin bir “kişilik tutarsızlığı” değil, yalnızca farklı metin örüntülerini üretmesinden ibarettir. ChatGPT’nin zamanı söyleyememesi ise bir “yetersizlik” değil, sisteme dış veri akışı olmamasının doğal sonucudur.

Bugün gelinen noktada asıl ihtiyaç, modellerin insan iletişiminin kültürel çeşitliliğini daha iyi kavrayacak şekilde eğitilmesi kadar, kullanıcıların da bu sistemlerin nasıl çalıştığını daha bilinçli biçimde anlaması. Aksi halde, istatistiksel bir üretim aracını bir konuşma öznesi sanmak, hem teknik beklentileri hem sosyal yorumları yanıltmaya devam edecek gibi görünüyor.

Kaynak : https://www.donanimhaber.com/yapay-zekalar-hatali-kultursuz-ve-zamani-soyleyemiyor–199163