Nvidia’nın GTC 2026 kapsamında yaptığı duyurular sadece işbirlikleri ve yazılım tarafıyla ilgili değil. Şirket, donanım tarafında da yeni nesil çözümlerini duyurdu. Bunlardan birisi olan Groq 3’ün halihazırda Samsung tarafından 4nm sürecinde seri üretime girdiği açıklandı.

Nvidia’nın GTC 2026 kapsamında yaptığı duyurular sadece işbirlikleri ve yazılım tarafıyla ilgili değil. Şirket, donanım tarafında da yeni nesil çözümlerini duyurdu. Bunlardan birisi olan Groq 3’ün halihazırda Samsung tarafından 4nm sürecinde seri üretime girdiği açıklandı.

Groq 3, Nvidia’nın yaklaşık 20 milyar dolarlık Groq lisans anlaşması kapsamında geliştirildi. Bu anlaşma, geçen yıl Noel arifesinde imzalanmış ve Nvidia’ya Groq’un temel teknolojisi ile kurucu Jonathan Ross dahil kritik personel kazandırmıştı. Samsung’un üretim birimi, Groq çiplerini 4 nm süreciyle üretiyor. Startup, örnek üretimden büyük ölçekli ticari üretime geçiş sürecinde üretimi yaklaşık 9.000 wafer’dan 15.000 wafer’a çıkardı.

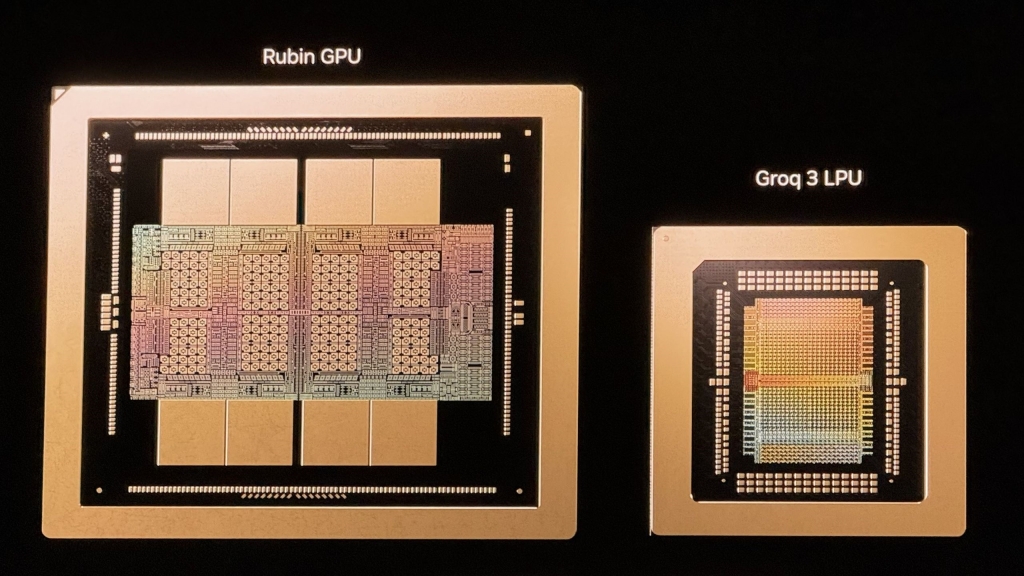

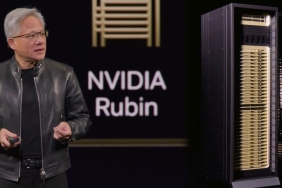

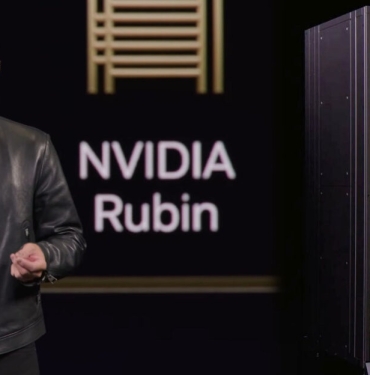

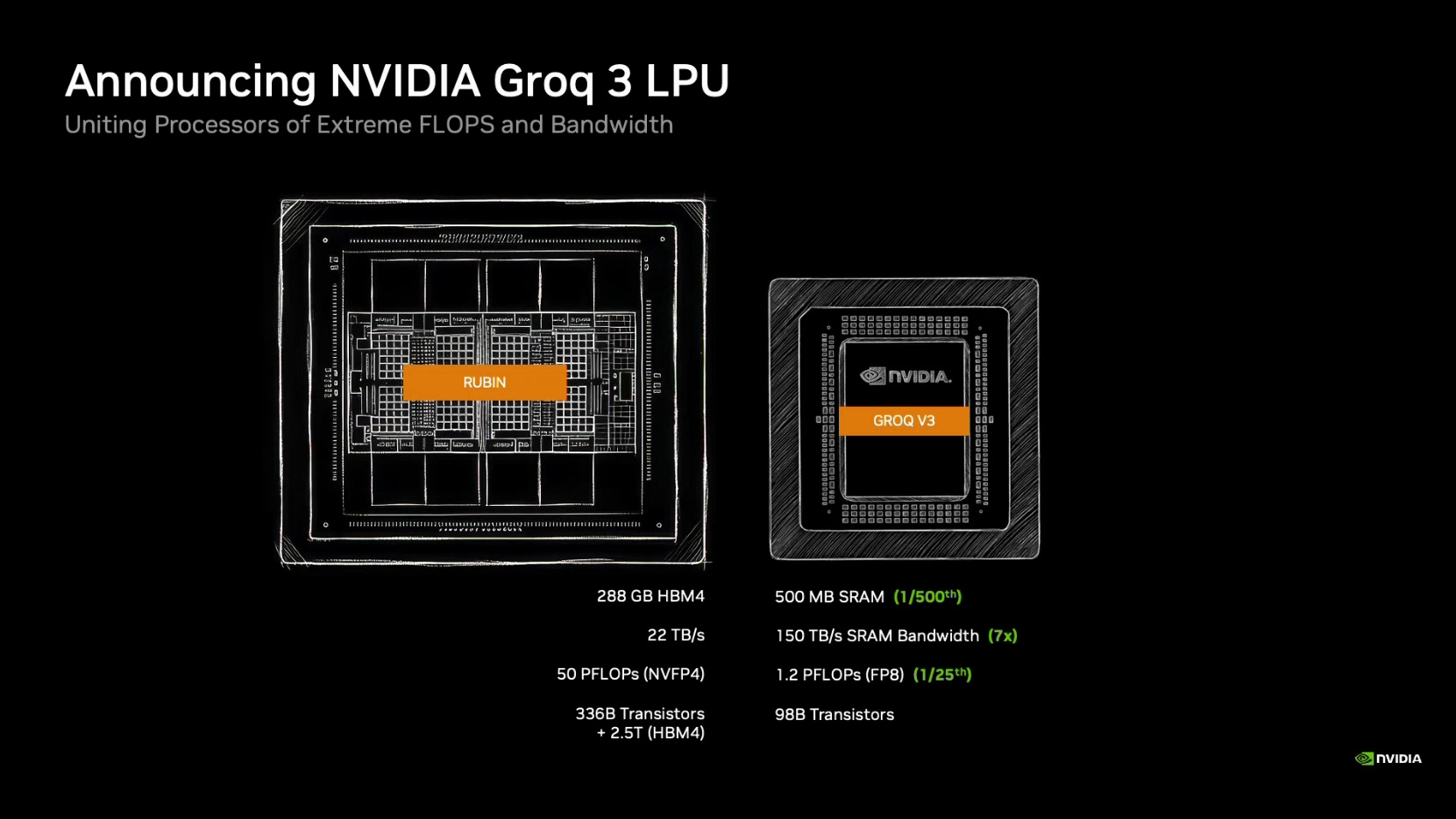

Rubin platformuna Groq 3 LPU entegrasyonu

Nvidia’nın Vera Rubin platformu, Groq 3 LPU’nun eklenmesiyle önümüzdeki nesil AI veri merkezleri için yeni bir güç kazanıyor. Groq 3, özellikle çıkarım (inference) hızını artıran LPU (Language Processing Unit- Dil İşleme Birimi) olarak dikkat çekiyor. Her LPU, geleneksel yüksek bant genişliğine sahip belleğin yerine çip üzerinde 500 MB SRAM barındırıyor. Bu miktar, Rubin GPU’larındaki 288 GB HBM4’ün yanında küçük kalsa da 150 TB/s bant genişliği ile düşük gecikmeli ve yüksek hacimli token işleme performansı sağlıyor.

Rubin platformu Groq 3 öncesinde altı farklı çiple ölçeklenmiş rack sistemleri sunuyordu. Groq 3 LPU, bu yapıya yeni bir yapı taşı olarak eklenerek Rubin’in çok daha yüksek performanslı ve düşük gecikmeli AI çıkarım kapasitesi kazanmasını sağlıyor.

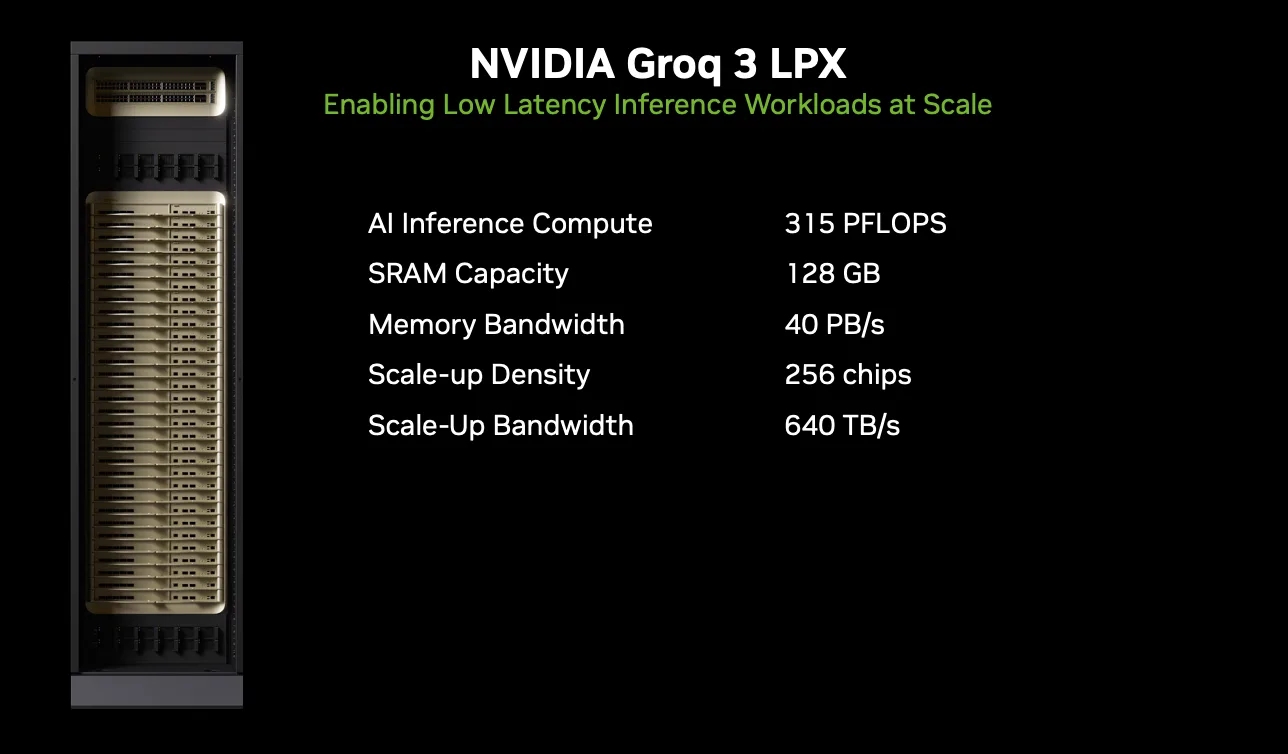

Rubin platformu Groq 3 öncesinde altı farklı çiple ölçeklenmiş rack sistemleri sunuyordu. Groq 3 LPU, bu yapıya yeni bir yapı taşı olarak eklenerek Rubin’in çok daha yüksek performanslı ve düşük gecikmeli AI çıkarım kapasitesi kazanmasını sağlıyor. Nvidia, Groq 3 LPX raflarını 256 LPU ile donatmayı planlıyor. Bu raf, toplam 128 GB SRAM ve 40 PB/s bant genişliği sunuyor ve her raf için özel 640 TB/s ölçeklenebilir arayüz sağlanıyor. Rubin ile birlikte çalıştığında Groq LPX, AI modelinin her katmanında, her token için çıkarım performansını artırarak özellikle çok ajanlı sistemlerde yüksek interaktiviteyi mümkün kılıyor. Nvidia’ya göre bu yapı özellikle AI ajanlarının birbirleriyle yüksek hızda iletişim kurmasını sağlayacak ve saniyede 100 token seviyesinden 1.500 TPS ve üzerine çıkabilecek bir performans sunacak. Daha anlaşılır bir dil ile söyleyecek olursak bu, devasa modellerin düşük gecikme ile çalıştırılması açısından kritik bir avantaj sağlayacak.

Kaynak : https://www.donanimhaber.com/nvidia-dan-ai-performansini-artiran-yeni-nesil-cip–203302