Türkiye’deki geleneksel medya ve aslında tüm dünya genelindeki yorumcuların günümüz yapay zekası hakkında spekülasyon yaptıklarında kenara 1 dolar atsaydım muhtemelen milyoner olurdum. İnsanlar “yapay zeka” dediğimiz şeyin programcılar tarafından klavyelerinde yazılan bir grup bilgisayar kodu olduğunu unutuyorlar. Bu spekülasyonlar çoğu zaman GPT-4, GPT-4o veya Google Gemini 1.5 gibi Büyük Dil Modellerinin (LLM) yeteneklerinde yaşanan hızlı yükselişten kaynaklanıyor ve bunun bir kısmı anlaşılabilir. Ancak ortada bir sihir olmadığının farkında olmak önemli.

Türkiye’deki geleneksel medya ve aslında tüm dünya genelindeki yorumcuların günümüz yapay zekası hakkında spekülasyon yaptıklarında kenara 1 dolar atsaydım muhtemelen milyoner olurdum. İnsanlar “yapay zeka” dediğimiz şeyin programcılar tarafından klavyelerinde yazılan bir grup bilgisayar kodu olduğunu unutuyorlar. Bu spekülasyonlar çoğu zaman GPT-4, GPT-4o veya Google Gemini 1.5 gibi Büyük Dil Modellerinin (LLM) yeteneklerinde yaşanan hızlı yükselişten kaynaklanıyor ve bunun bir kısmı anlaşılabilir. Ancak ortada bir sihir olmadığının farkında olmak önemli.

Aslında bu konu bir okuyucumuz (@E_Y_B_H_P_T) tarafından birkaç ay önce önerildi. Okuyucumuz yapay zekaların ve firmaların hakkımızda tuttukları verileri ne kadar sakladıklarını ve onlarla ne yaptıklarını merak ediyordu. Konu güzeldi ancak bunu doğru bir şekilde cevaplamak için öncelikle “yapay zeka” dediğimiz bu araçların çalışma şeklini irdelemek gerekiyor. Bu irdeleyiş çok kısa olmayacak.

Yapay zekalar nasıl çalışıyor ve LLM’ler nedir?

GPT-4 ve yeni çıkan GPT-4o’nun yeteneklerinden herkes gibi ben de etkilendim ve büyük bir heyecan içerisindeyim gelecek hakkında. Ancak bir LLM’nin ne olup ne olmadığını kendimize hatırlatmamız gerekiyor. Bilim kurgu yazarı Ted Chiang, (Arrival, Exhalation, Stories of Your Life) LLM’leri “web’in bulanık bir JPEG’i” olarak tanımlıyor. Bu oldukça basitleştirilmiş bir tanımlama ancak çok da isabetsiz değil.

Günümüzün tüm büyük dil modelleri (yazı boyunca artık LLM kısaltması kullanılacak) gerçek bir anlayıştan ziyade olasılıklar ve istatistiksel ilişkiler temelinde çalışırlar. Bu ayrım, hem yeteneklerini hem de sınırlamalarını anlamak açısından çok önemli. Bu anlayışın birinci noktası şu; LLM’ler, çok gelişmiş bir örüntü tanıma biçimi olan bir dizideki sonraki jetonu (kelimeyi) istatistiksel olarak tahmin etmek için geniş veri setleri (metin) üzerinde eğitiliyor ve daha sonra istenen sonuçlara ulaşmak için insan mühendisler tarafından manuel olarak ince ayarlamalarla şekillendiriliyorlar.

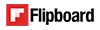

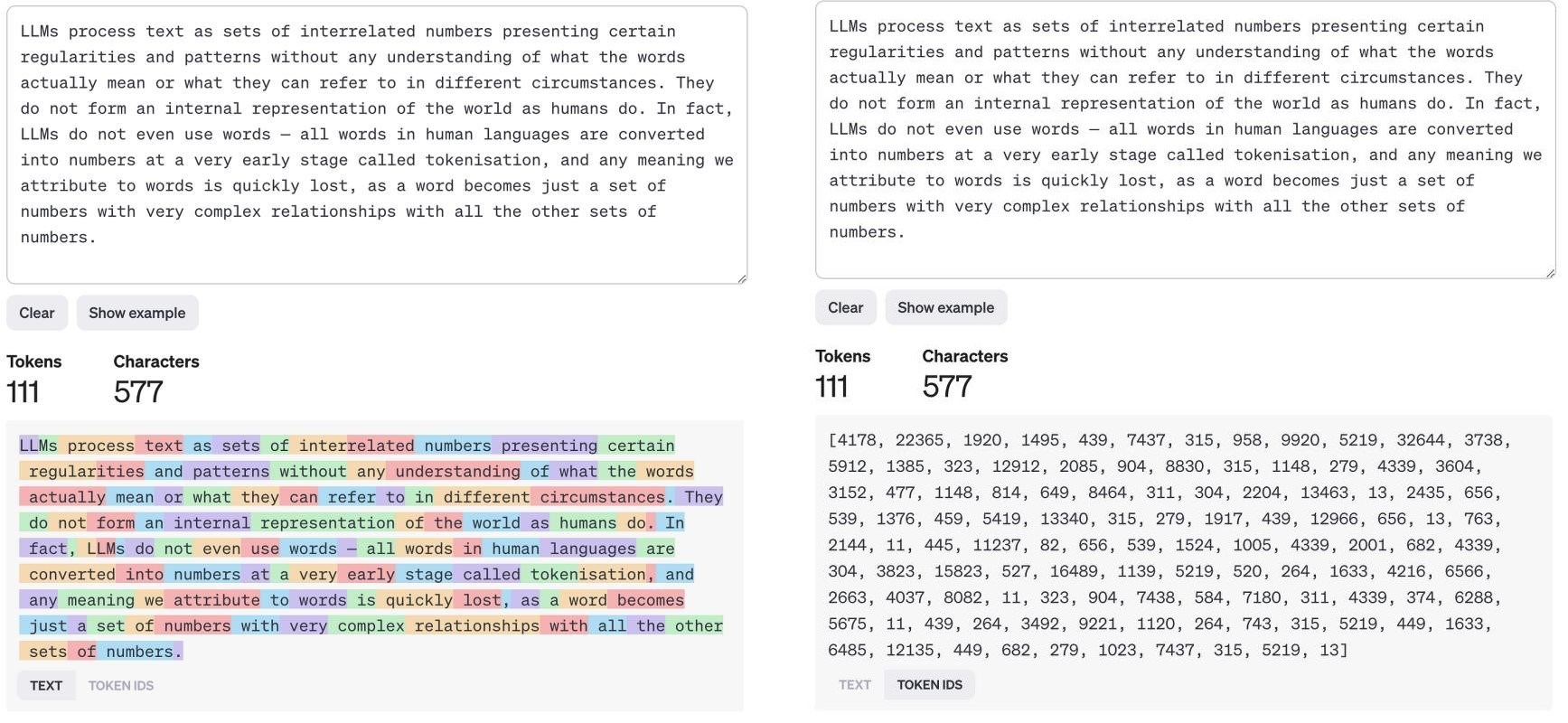

Günümüzün tüm büyük dil modelleri (yazı boyunca artık LLM kısaltması kullanılacak) gerçek bir anlayıştan ziyade olasılıklar ve istatistiksel ilişkiler temelinde çalışırlar. Bu ayrım, hem yeteneklerini hem de sınırlamalarını anlamak açısından çok önemli. Bu anlayışın birinci noktası şu; LLM’ler, çok gelişmiş bir örüntü tanıma biçimi olan bir dizideki sonraki jetonu (kelimeyi) istatistiksel olarak tahmin etmek için geniş veri setleri (metin) üzerinde eğitiliyor ve daha sonra istenen sonuçlara ulaşmak için insan mühendisler tarafından manuel olarak ince ayarlamalarla şekillendiriliyorlar. Sesinizi tanımak, insan gibi konuşmak ya da kedi resimleri oluşturmak için tasarlanan yapay zeka sistemleri bu LLM’leri barındırıyor. LLM’ler dediğimiz gibi çok büyük veri kümeleriyle eğitiliyor ve şirketler genellikle bu kümeleri açıklamamaya özen gösteriyor. Nereden gelirse gelsin tüm bu veriler birden fazla düğüm ve katmandan oluşan bir sinir ağı aracılığıyla işleniyor.

Yani, LLM’lerin inanılmaz gücü, herhangi bir kavram veya fikir anlayışından ziyade tamamen bu kalıpların ve olasılıkların tanınmasına ve yeniden oluşturulmasına dayanıyor. Dikkat edilmesi gereken ilk husus budur. Aslında bunu metinsel yapay zeka araçlarında görmüş olabilirsiniz. Bir LLM’ye bir şeyleri daha derin ve daha detaylı açıklaması için baskı yaptığınızda onun bir noktada faydalı bilgi vermeyi bıraktığını ve sanki daireler çizmeye başladığını fark etmişsinizdir.

Biz insanlar bilinç, biliş ve yeni bilgileri yapısal sınırlamalar olmaksızın mevcut bilgi ve deneyimlerimizle ilişkilendirebiliyoruz. LLM’lerin deneyimleri ya da görüşleri olmadığından ve olamayacağından, işleyişleri tamamen hesaplamaya dayalıdır ve kişisel bağlamdan ya da deneyimsel öğrenmeden yoksundur.

LLM’ler bağlamla ilgili ve biçimsel olarak doğru olan etkileyici yanıtlar üretebilseler de bunu, gerçek bir anlayışa veya metnin arkasındaki daha derin anlamlara değil, sayısal dizilerin istatistiksel olasılığına dayanarak yapıyorlar. Dolayısıyla GPT-4 gibi gelişmiş bir modelle etkileşime girdiğinizde onun bir şeyleri gerçekten bildiği hissine kapılmanız bir yanılsamadır: Yaptığı şey şaşırtıcı olsa da gerçekte yaptığı şey aslında “anlamak” değildir.

İnsanlar zihinlerindeki kavramları dünyadaki deneyimleriyle ilişkilendirerek bir şeyleri anlar veya anlamlandırır. Öte yandan LLM’ler kelimelerin gerçekte ne anlama geldiğini veya farklı durumlarda neye işaret edebileceklerini anlamaksızın belirli düzenler ve kalıplar sunan birbiriyle ilişkili sayı kümeleri olarak görürler.

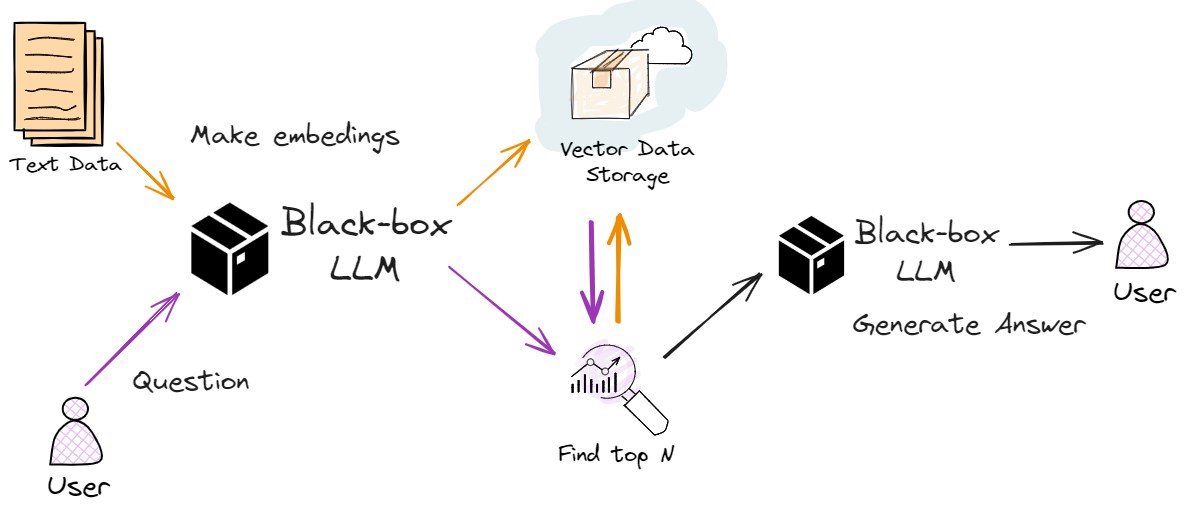

İnsanlar zihinlerindeki kavramları dünyadaki deneyimleriyle ilişkilendirerek bir şeyleri anlar veya anlamlandırır. Öte yandan LLM’ler kelimelerin gerçekte ne anlama geldiğini veya farklı durumlarda neye işaret edebileceklerini anlamaksızın belirli düzenler ve kalıplar sunan birbiriyle ilişkili sayı kümeleri olarak görürler. Aslında LLM’ler kelimeler de kullanmazlar. İnsan dillerindeki tüm kelimeler tokenizasyon adı verilen çok erken bir aşamada sayılara dönüştürülür ve diğer sayı kümeleriyle ilişkilendirilip bu ilişkiye bakılır. Bu da kelimelere atfettiğimiz her türlü anlamın kaybolduğunu gösteriyor. Haliyle LLM’lerin ilgilendiği şey kelimeler veya diller değil, bunların matematiksel temsilleridir. Her ne kadar bunlara “Büyük Dil Modelleri” desek de bu söylem eksiktir.

Matematikte daha doğrusu istatistikte kesinliğe ulaşmak için veri kümesinin büyük olmasını isteriz. Dolayısıyla LLM’lerin performansı da büyük ölçüde eğitim verilerine bağlıdır. Ya veriler çok fazla olacak (trilyonlarca parametre) ya da veriler o kadar kaliteli olacak ki bunlardan çıkarım yapmak daha kesin sonuçlar ortaya koyacak. Zaten aslında bu durum ChatGPT’nin adında da bizlere gösteriliyor: (Chat’ten sonra gelen GPT, Generative Pretrained Transformer – Önceden eğitilmiş üretken dönüştürücü– anlamına geliyor)

Verilerin miktarı ve kalitesi arttıkça LLM’lerin kelimelerin ve cümlelerin birbirleriyle nasıl ilişkili olduğuna dair kalıpları tespit etmesi ve ardından hangi kelimelerin gelmesi gerektiğine dair tahminlerindeki performans artacaktır. GPT-4o an itibariyle bunu en iyi yapan yapay zeka. Buradaki gelişmeler ilerledikçe ortaya konan şeyler düşünce ve yaratıcılık gibi görünmeye başlıyor.

Biraz daha derine indiğimizde LLM’lerin içindeki dönüştürücülerin bir öz dikkat içerdiğini görüyoruz. En basit haliyle bu, bir cümledeki kelimelerin tek başına değil, aynı zamanda çeşitli sofistike yollarla birbirleriyle olan ilişkilerinin değerlendirilmesi anlamına geliyor. Bu dönüştürücülerde bir miktar doğaçlama da bulunuyor. Bu yüzden ChatGPT veya Gemini’ye aynı soruyu sorduğunuzda aynı cevabı almıyorsunuz. Bu durum aynı zamanda hataların ortaya çıkışını da açıklıyor. ChatGPT örneğinden devam edecek olursa bot, her zaman bir sonraki en olası kelimeyi değil, ikinci veya üçüncü en olası kelimeyi de seçebiliyor; Dolayısıyla yapay zekalar “Türkiye Cumhuriyeti’nin ilk Cumhurbaşkanı …’dır” cümlesinde gelecek kelimeye her zaman Mustafa Kemal Atatürk demeyebilir, kendilerinde başka bir ismin oraya gelme olasılığı daha yüksek olabilir.

Bu süreçte LLM’ler sürekli bir öz analiz ve öz düzeltme yaparlar. Bu durum da verilen yanıtların zaman zaman çok basit olmasına veya aslında hiçbir bilgi içermemesine sebep olabilir. Bu, biraz da verdiğiniz girdiyle de alakalı. Yani araç, verdiği yanıtlarda hep orta yollu olmayı seçiyor. Bir şeyi taklit etmesini istediğiniz onu aklınıza gelen en bariz şekilde yapıyor. Tüm bunlar olurken insan mühendisler de “insan geri bildirimi üzerine takviyeli öğrenme” (RLHF) yoluyla yapay zekaların eğitiminde çıktıları üzerinde ince ayarlar yapıyorlar.

Yapay zeka sizi unutabilir mi? Verileri silmek mümkün mü?

GPT-4o veya Gemini gibi yapay zekalara güç veren LLM’lerin büyük veriler üzerinde eğitildiği söyledik. Bu veriler kitaplar, akademik araştırmalar, açık kütüphaneler, lisanslanmış içerikleri, kamuya açık veriler ve internetin erişilebilir her yerini içerebiliyor. Bu büyük verilerin giderek büyüyor olması veri gizliliği ve kişisel bilgilerin etik kullanımı hakkında endişeler de doğuruyor. Çünkü bu veriler içerisinde isimler, e-postalar veya hassas bilgiler olabilir. Firmalar her ne kadar veri filtreleme ve anonimleştirme tekniklerini kullandıklarını söylese de hiçbir kişisel bilginin dahil edilmediğini garanti etmiyorlar.

GPT-4o veya Gemini gibi yapay zekalara güç veren LLM’lerin büyük veriler üzerinde eğitildiği söyledik. Bu veriler kitaplar, akademik araştırmalar, açık kütüphaneler, lisanslanmış içerikleri, kamuya açık veriler ve internetin erişilebilir her yerini içerebiliyor. Bu büyük verilerin giderek büyüyor olması veri gizliliği ve kişisel bilgilerin etik kullanımı hakkında endişeler de doğuruyor. Çünkü bu veriler içerisinde isimler, e-postalar veya hassas bilgiler olabilir. Firmalar her ne kadar veri filtreleme ve anonimleştirme tekniklerini kullandıklarını söylese de hiçbir kişisel bilginin dahil edilmediğini garanti etmiyorlar. Bununla birlikte yapılan araştırmalar gösteriyor ki LLM’den hassas verilerin kalıcı olarak silinmesi ve verilerin gerçekten silinip silinmediğinin doğrulanması oldukça zor. Yukarıda modellerin insanlar tarafından RLHF yöntemiyle ince ayarlarla şekillendirildiğini söylemiştik. Araştırmacılar, çoğu LLM’nin RLHF’den, yani pratikte modelin korkuluklarla çevrilmesinden sonra bile “düşmanca yönlendirmelere” karşı hala savunmasız olduğunu söylüyor. Bu yönlendirmeler modellerden spesifik verilerin çıkartılmasını içeriyor. Sonuç olarak, hassas bilgilerin modelin parametreleri içine gömülmesi ve üretilen çıktıları potansiyel olarak etkilemesi mümkündür.

Gizlilik endişelerini gidermek amacıyla, büyük dil modellerini işleten kuruluşlar, bireylerin kişisel verilerinin kaldırılmasını talep etmelerine olanak tanıyan mekanizmalar oluşturmuş durumda. Yani isterseniz bu araçlarla olan konuşmalarınızı ve hesabınızı kalıcı olarak silebilirsiniz. Söylemeye gerek var mı bilmiyorum ancak evet, bu araçlarla yaptığınız konuşmalar eğitim verisi olarak kullanılıyor. Firmalara kişisel verilerinizin silinmesi talebinde bulunduğunuzda bunları eğitim setinden çıkaracaklardır.

OpenAI, sizden topladığı verileri ne kadar süreyle sakladığı ve kullandığını tam olarak açıklamıyor. Google ise en az üç yıl bunları saklıyor. Elbette firmalar bunları doğrudan sizi tespit edecek ayrıntıları (isim, adres vb.) çıkararak saklıyor. Ancak daha önceki haberlerimizde aktardığımız gibi, dolaylı verilerle sizin kim olduğunuzu bulmak zor değil.

OpenAI, sizden topladığı verileri ne kadar süreyle sakladığı ve kullandığını tam olarak açıklamıyor. Google ise en az üç yıl bunları saklıyor. Elbette firmalar bunları doğrudan sizi tespit edecek ayrıntıları (isim, adres vb.) çıkararak saklıyor. Ancak daha önceki haberlerimizde aktardığımız gibi, dolaylı verilerle sizin kim olduğunuzu bulmak zor değil. Fakat burada üstünde durulmayan bir sorun var. Siz, bugün verilerinizin kaldırılmasını isteseniz ve bugün bu verileriniz eğitim verilerinden kaldırılsa bile yapay zekanın sizi unutması garanti edilemez, eğer bu verileriniz bir kere model eğitiminde kullanıldıysa. Bunun nedeni, modelin zaten eğitilmiş ve ilk verilere dayalı kalıpları öğrenmiş olmasıdır. Bir insan benzetmesi yapmak gerekirse, yapay zeka bir şeyi “gördükten” sonra, modele gördüklerini “unutmasını” söylemenin kolay bir yolu yoktur. Sonuç olarak, kaldırılan verilerin etkisini tamamen ortadan kaldırmanın tek yolu tüm modeli yeniden eğitmektir ki bu da maliyetli ve zaman alıcı bir süreç olabilir.

Bu modellerden bir verinin silinmesinin zor olma nedeni bizi en başta LLM’lerin ne olduğunu açıkladığımız bölüme yönlendiriyor. Çünkü bir yapay zeka modeli sadece kodlama satırlarından ibaret değil, belirli bir veri kümesindeki noktalar arasında öğrenilmiş bir dizi istatistiksel ilişkiden oluşuyor. Model bu ilişkiyi öğrendikten sonra, modelin öğrendiklerinin bir kısmını göz ardı etmesini sağlamanın basit bir yolu yok. Dahası bazı çalışmalar modellerin bu ilişkileri tam olarak nasıl kurduğunu bilmediğimizi gösteriyor. Bunu OpenAI’ın CEO’su Sam Altman söylüyor.

Aslında pek araştırılmayan bir konu da var. Sadece kişisel veriler değil, bu modellerden bir veriyi silmek, modelin performansını ne derecede etkiliyor. Bilirsiniz, “Kelebek Etkisi” diye bir şey var. Gerçekten de istatistiksel olarak burada kanat çırpan bir kelebek dünyanın bir ucunda bir fırtınaya sebep olabilir. Peki, bu modellerden bir veriyi silmek de benzer bir etki yaratabilir mi? Yapılan az sayıdaki araştırma bunun mümkün olabileceğini söylüyor.

Xiaomi’den fütüristik su tabancası

Efsane Türkiye’ye gelse alırım..

O ışık efektleri sadece yanlarda değil üstte de olmalıydı. Böylece tabancayı kullanan, kafasını yana eğmek zorunda kalıp, fıtık olmaz. Aynısını küçükken ışıklı ayakkabımda yaşamıştım oradan biliyorum. Ayakkabıma yan bakmaktan düz yürüyemiyordum. Hava atmaktan ziyade o havayı yaşamayı tercih ederim. 7 de olsam 70 de olsam kararım değişmeyecek.

Mukemmel bir silah acaba ne kadar hızlı atıyor. [resim] [resim]

Fiyat makul olsa efsane olur gerçekten ya.

Vay bee, bu cihaz xiaomi çıktı ben de diyordum kim üretmiş..

hocam 4x daha iyi direk hs attirir

Über

Evet ama 6x scop daha iyi gider buna daha uzaktaki hedefler için. Gerektiğinde 3x’e de çekebilirsin falan :D

Muskun alev tabancası vs bu

İstilacı güvercinlere karşı iyi olur. 5 10 dk da bir sopayı alıp kovalamak yordu artık.

Yakında su atan F18 falanda yaparlar :)

Hazneye kezzaplı su doldurup nişan almak yapmayın böyle şeyler yahu…

Xiaomi kendini çok geliştirdi artık her alanda kaliteli işler yapıyorlar.

fışkırttığı su mermi gibi isabetli gitmeyeceği için gereksiz diye düşünmüş olabilirler.

Lazer nişangah da eklenseymiş tadından yenmezmiş.

Kaynak : https://www.donanimhaber.com/yapay-zekalar-nasil-calisiyor-verilerimizi-silebilir-miyiz–178199